GPT-5.4 ya puede usar tu ordenador de forma autónoma: OpenAI da el salto al "computer use" en su modelo principal

por Edgar OteroOpenAI ha presentado GPT-5.4, un nuevo modelo que llega con un cambio de enfoque relevante respecto a sus predecesores. Hasta ahora, las capacidades de uso autónomo del ordenador, lo que en el sector se denomina computer use, estaban reservadas a modelos especializados. Con GPT-5.4, OpenAI las integra por primera vez en un modelo de propósito general, disponible tanto en ChatGPT como en su API y en Codex, su entorno de desarrollo.

El lanzamiento llega apenas días después de que la compañía mostrara GPT-5.3 Instant, una actualización centrada en mejorar la fluidez y la precisión de las respuestas cotidianas. GPT-5.4 apunta a un territorio diferente: tareas largas, complejas y que requieren que el modelo actúe por sí solo durante un tiempo prolongado sin que el usuario tenga que intervenir en cada paso.

Un modelo que puede ver, hacer clic y completar tareas en el ordenador

La novedad más destacada de GPT-5.4 es su capacidad para interactuar con interfaces gráficas del mismo modo en que lo haría una persona: interpretando capturas de pantalla, haciendo clic en elementos, rellenando formularios o navegando por aplicaciones. OpenAI posiciona este modelo como la mejor opción disponible para desarrolladores que quieran construir agentes capaces de completar tareas reales en entornos de escritorio o web.

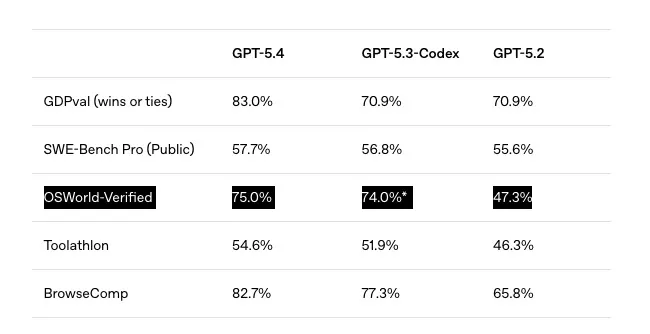

En los benchmarks publicados por la compañía, GPT-5.4 obtiene un 75% de éxito en OSWorld-Verified, una prueba que mide la capacidad de un modelo para navegar entornos de escritorio usando capturas de pantalla y comandos de teclado y ratón. La cifra supera el 72,4% registrado por humanos en la misma prueba y mejora de forma notable el 47,3% que alcanzaba GPT-5.2. Sin embargo, conviene tomar estos datos con cautela: los benchmarks se ejecutan en condiciones muy controladas y no siempre reflejan el rendimiento real en entornos de uso cotidiano, donde las variables son mucho más impredecibles.

Lo que sí resulta significativo es el salto respecto a la generación anterior. La diferencia de casi 28 puntos porcentuales entre GPT-5.4 y GPT-5.2 en esa prueba sugiere un avance real en la capacidad del modelo para desenvolverse en interfaces visuales, más allá de lo que los números concretos puedan indicar por sí solos.

Esta capacidad de computer use se apoya en una mejora general de la percepción visual del modelo. GPT-5.4 procesa imágenes de mayor resolución, hasta 10,24 megapíxeles, lo que le permite interpretar con más precisión elementos pequeños de una interfaz, como botones, menús desplegables o campos de texto. OpenAI también introduce un nuevo parámetro de detalle de imagen en la API para aprovechar esta capacidad al máximo.

Trabajo profesional, código y menos alucinaciones

Más allá del computer use, GPT-5.4 incorpora las capacidades de programación que OpenAI había desarrollado en GPT-5.3-Codex, integrándolas en un único modelo. El resultado es un sistema que puede encargarse de tareas de desarrollo sin perder competencia en otras áreas como la redacción, el análisis de datos o la gestión de documentos.

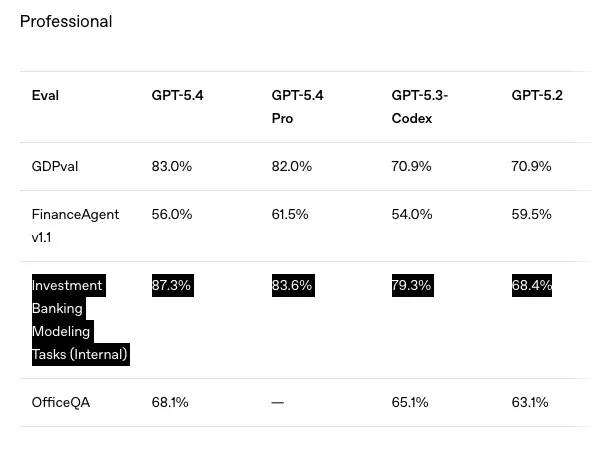

En el ámbito del trabajo profesional, OpenAI ha puesto el foco en hojas de cálculo, presentaciones y documentos. Según sus propias métricas internas, el modelo resuelve correctamente el 87,3% de las tareas de modelado financiero que correspondería hacer a un analista júnior de banca de inversión, frente al 68,4% de GPT-5.2. De nuevo, las condiciones de laboratorio no son el mundo real, pero la dirección del avance es clara.

En materia de alucinaciones, OpenAI afirma que las afirmaciones individuales de GPT-5.4 tienen un 33% menos de probabilidades de ser incorrectas en comparación con GPT-5.2, y que sus respuestas completas contienen errores un 18% menos frecuentemente. Son mejoras relevantes, especialmente para usos profesionales donde la fiabilidad importa, aunque la compañía no detalla la metodología exacta de medición.

Otro cambio técnico notable es la introducción de búsqueda de herramientas en la API. Hasta ahora, cuando un agente tenía acceso a muchas herramientas externas, sus definiciones se incluían íntegramente en cada consulta, encareciendo y ralentizando el proceso. Con GPT-5.4, el modelo puede buscar y cargar solo las herramientas que necesita en cada momento, reduciendo el consumo de tokens hasta un 47% en pruebas con entornos de múltiples herramientas.

Disponibilidad y precio

GPT-5.4 está disponible desde hoy para usuarios de ChatGPT Plus, Team y Pro bajo el nombre GPT-5.4 Thinking, reemplazando a GPT-5.2 Thinking como modelo razonador principal. GPT-5.2 Thinking permanecerá accesible durante tres meses en la sección de modelos heredados antes de ser retirado el 5 de junio de 2026. Los usuarios de planes Enterprise y Edu pueden activarlo de forma anticipada desde los ajustes de administrador.

En la API, el precio de entrada es de 2,50 dólares por millón de tokens, frente a los 1,75 de GPT-5.2. OpenAI argumenta que la mayor eficiencia del modelo reduce el número total de tokens necesarios para completar tareas, lo que en la práctica podría compensar parte del aumento de coste dependiendo del tipo de uso. También existe una versión GPT-5.4 Pro, orientada a tareas de máxima complejidad, disponible para suscriptores

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!